Come riconoscere un deepfake in 3 mosse (Senza essere un esperto di intelligenza artificiale).

- Andrea Tenna

- 9 apr

- Tempo di lettura: 3 min

Aggiornamento: 15 mag

Un deepfake è un contenuto video, audio o fotografico generato o manipolato dall'intelligenza artificiale per far sembrare che una persona dica o faccia qualcosa che non ha mai detto o fatto. Riconoscere un deepfake è possibile anche senza essere esperti: bastano tre mosse e un'abitudine mentale.

Nel capitolo dedicato al Deepfake ho scritto di Resemble AI, FakeCatcher di Intel e degli strumenti che stanno nascendo per rilevare i contenuti sintetici. Ma la tecnologia di detection è ancora fuori dalla portata della maggior parte delle persone. Quello che invece è già alla portata di tutti è un metodo: un modo di guardare i contenuti digitali con occhi diversi. Non si tratta di diventare esperti di pixel. Si tratta di sviluppare un'abitudine mentale. Quella che i fact-checker chiamano "sano scetticismo attivo" - non paranoia, ma attenzione consapevole.

MOSSA 1 — Fermati prima di condividere

Il deepfake non funziona perché è perfetto. Funziona perché sei di fretta. La stragrande maggioranza dei contenuti falsi che circolano sui social non supererebbe un esame di cinque secondi. Ma quei cinque secondi non li dedichiamo mai, perché scrolliamo veloci, reagiamo d'istinto, condividiamo per primi. È esattamente su questo che contano chi produce disinformazione. La prima regola è quindi la più semplice e la più difficile: fermati. Prima di reagire, prima di condividere, prima di credere - fermati. Chiediti: da dove viene questo video? Chi lo ha pubblicato per primo? In che contesto è stato registrato? Se non riesci a rispondere a nessuna di queste domande in trenta secondi, è già un segnale.

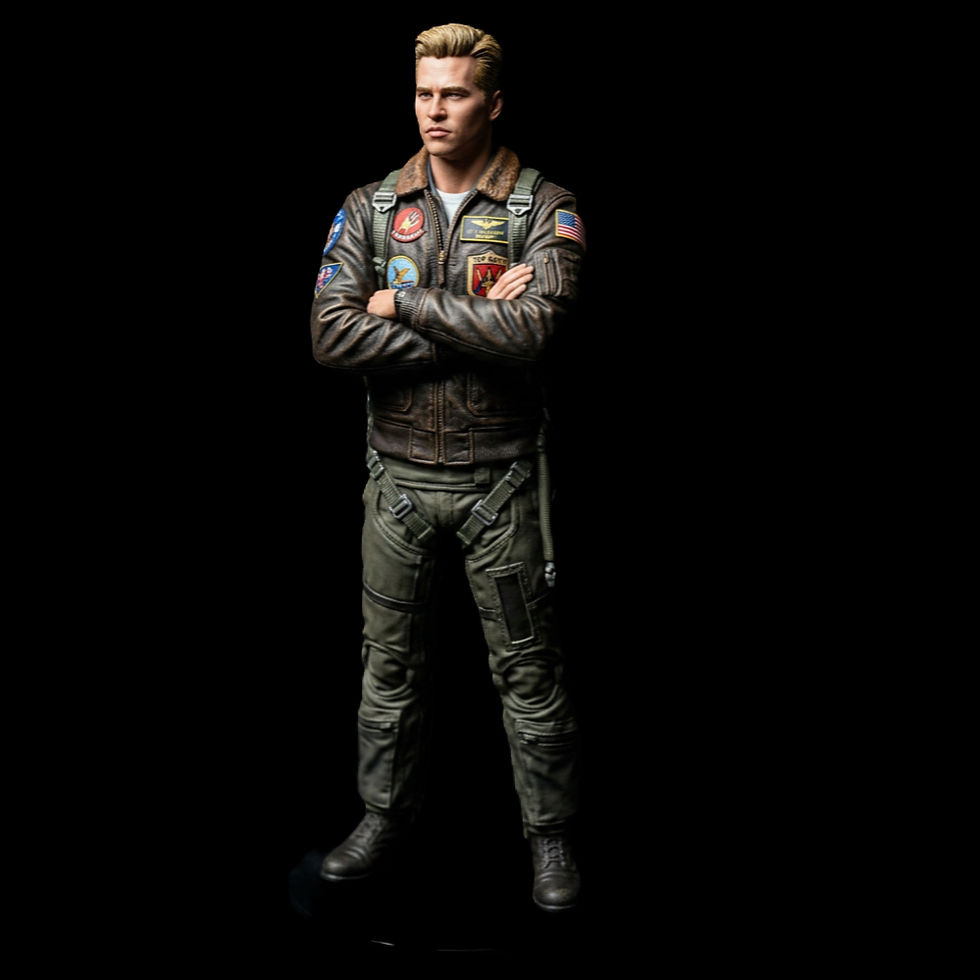

MOSSA 2 — Guarda quello che l'AI fatica ancora a fare bene

I modelli generativi sono straordinari su molte cose. Ma hanno ancora dei punti deboli riconoscibili, se sai dove guardare. Gli occhi: nei deepfake video il battito delle palpebre è spesso irregolare - troppo lento, troppo veloce, o assente. I bordi del volto: guarda la linea tra il viso e i capelli, o tra il viso e il collo. Nei deepfake questa transizione è spesso leggermente sfumata o artificiale. L'audio: ascolta se la voce corrisponde perfettamente ai movimenti delle labbra, e se l'ambiente sonoro è coerente. Un deepfake audio su un video reale spesso ha un ambiente sonoro diverso da quello visivo. Il contesto: il soggetto del video sta dicendo qualcosa di insolito, estremo, o perfettamente costruito per provocare una reazione emotiva forte? Quella è spesso la firma del deepfake.

MOSSA 3 — Verifica la fonte, non solo il contenuto

Il problema con i deepfake non è solo il contenuto - è il contesto in cui viene diffuso. Un video può essere autentico e usato in modo ingannevole (decontestualizzato, con data sbagliata, attribuito a una persona diversa). Prima di credere a qualcosa, cerca la fonte originale. Chi ha pubblicato per primo? Quando? In risposta a cosa? Strumenti come Google Images Reverse Search o TinEye permettono di risalire alla prima apparizione di un'immagine online in pochi secondi. Per i video esiste InVID/WeVerify. Non servono competenze tecniche - solo l'abitudine di cercare.

Questi contenuti sono estratti e approfonditi nel libro AI, AI, AI - Manuale distruzioni: Cinema, musica e social nell'era dell'Intelligenza Artificiale.

Domande frequenti sui deepfake

Cos'è un deepfake e come funziona?

Un deepfake è un contenuto sintetico — video, audio, immagine — generato o manipolato da algoritmi di intelligenza artificiale (in particolare reti neurali GAN) per far sembrare che una persona reale dica o faccia qualcosa che non ha mai detto o fatto. Il nome unisce "deep learning" e "fake".

Come si riconosce un deepfake senza strumenti tecnici?

Le tre mosse principali: (1) fermati prima di condividere e cerca la fonte originale; (2) osserva gli occhi (battito irregolare), i bordi del volto (transizioni artificiali) e la sincronia audio-labiale; (3) verifica se il contenuto è stato pubblicato da fonti verificabili e in quale contesto originale. La fretta è il principale alleato del deepfake.

Esistono strumenti gratuiti per rilevare i deepfake?

Sì: Google Reverse Image Search e TinEye per immagini, InVID/WeVerify per video. FakeCatcher di Intel è uno strumento professionale che analizza il flusso sanguigno nei video. Nessuno è infallibile, ma combinati con un metodo critico aumentano significativamente la capacità di rilevazione.

I deepfake sono illegali in Italia?

In Italia non esiste ancora una legge specifica sui deepfake, ma la loro diffusione può configurare reati già esistenti: diffamazione, sostituzione di persona, revenge porn (se a contenuto sessuale), truffa. L'AI Act europeo introduce obblighi di trasparenza per i contenuti sintetici, inclusa la marcatura obbligatoria dei deepfake.

Commenti